Pojawiają się natomiast pierwsze otwarte modele AI działające w podobny sposób. Świetnym przykładem jest tutaj Dream Machine od Luma AI.

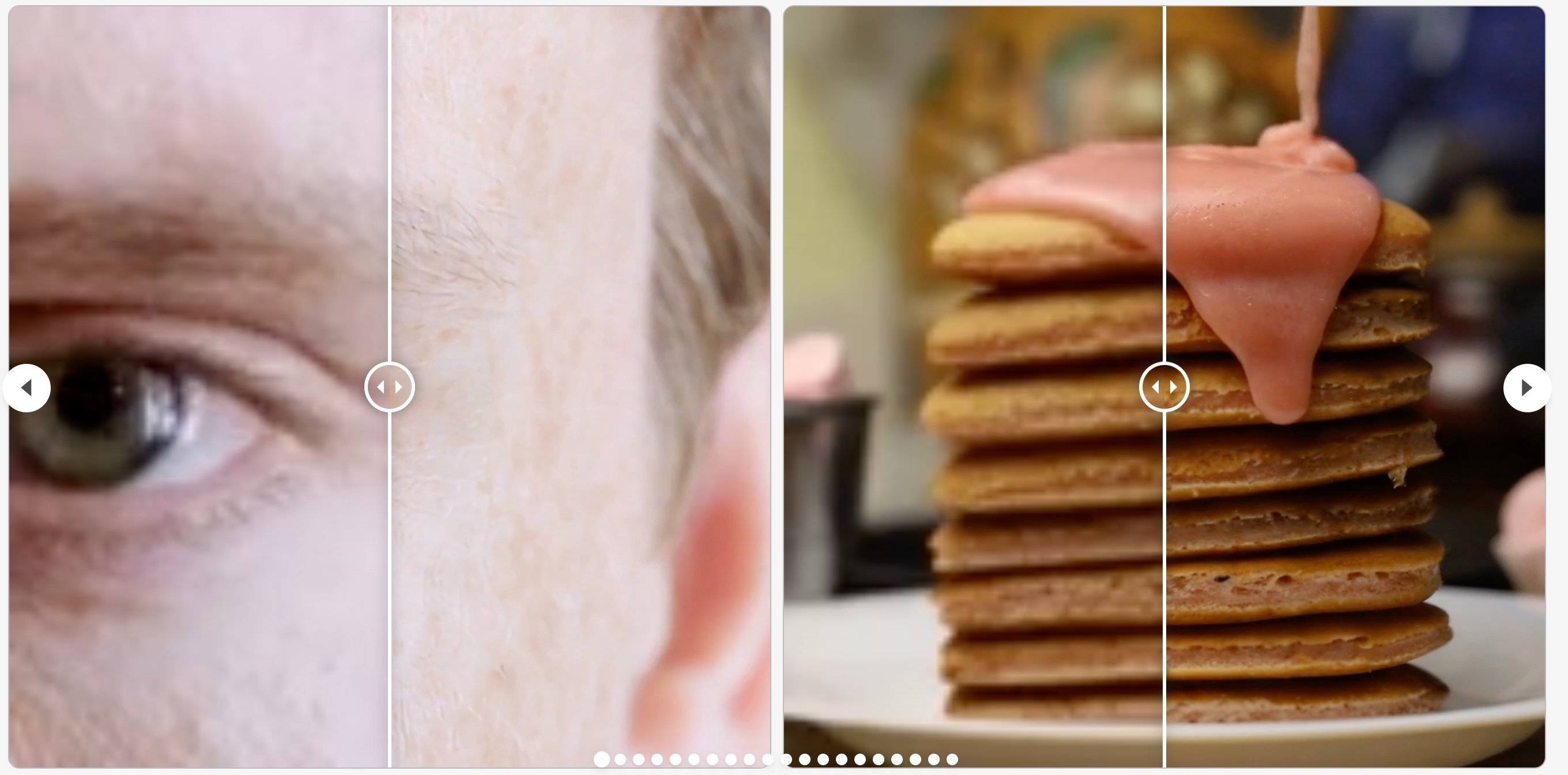

Różnica polega na tym, że na ten moment możecie samodzielnie sprawdzić ten modele. Wpisujecie tekst i po kilku sekundach (lub przy większym obciążeniu minutach) otrzymujecie wideo. Sam przetestowałem ok. 10 promptów i efekt przy niektórych był naprawdę niezły. Czas oczekiwania zaskakuje mocno na plus. Być może w tej chwili narzędzie nie jest popularne, ale wyniki otrzymywałem dosłownie w sekundy. W wersji darmowej możecie wygenerować 30 filmów (limit miesięczny).

Zachęcam do sprawdzenia: https://lumalabs.ai/dream-machine

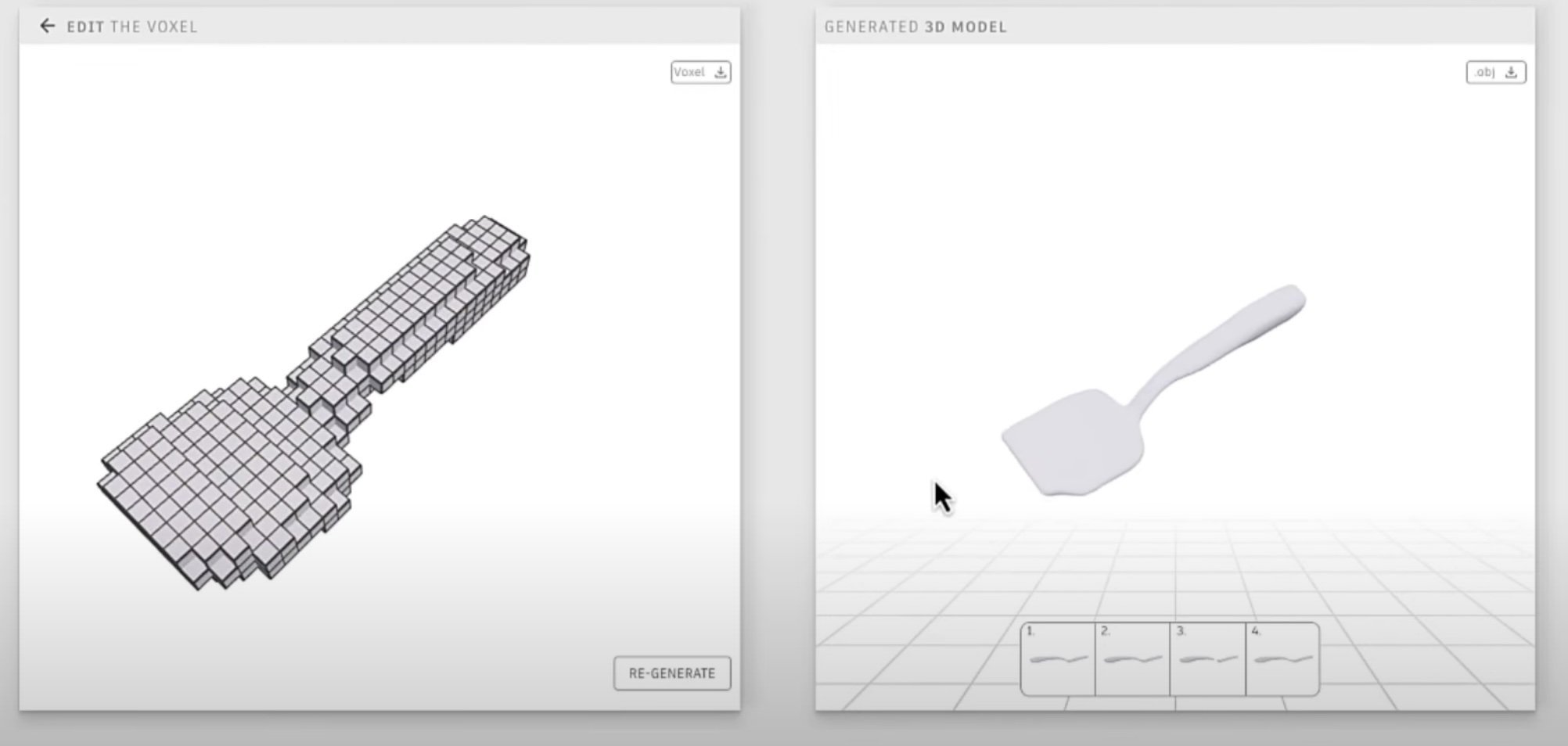

Kilka moich przykładów:

- 6 komentarzy

- 1 662 wyświetleń