Zawartość dodana przez kengi

-

Drobniejsze newsy, ciekawostki, misc

Quixel last breath... jakby ktoś chciał pobrać na forever.

-

Zurluk

- AI i technologie przyszłości

https://www.pcgamer.com/software/platforms/open-source-game-engine-godot-is-drowning-in-ai-slop-code-contributions-i-dont-know-how-long-we-can-keep-it-up/ Ciekawe czy już ktoś nie wpadł na pomysł, żeby w ten sposób "DDOS-ować" konkurencyjne projekty open source. A tu koleś kłóci się z ajbotem, który chce dorzucić kodu do projektu:- Eden

Nie kumam o co chodzi... tzn. coś tam sobie interpretuję... Najbardziej podoba mi się ujęcie ziomeczka jak się obraca 40-42 sek. chociaż ja bym tam zrobił cięcie. Szkoda, że użyłeś ejaj głosu, jako luddyta nie popieram. Już bym wolał jakiś 100% amatroszczyzny albo tekst na pasku. Niemniej gratulacje ukończenia projektu w dobie ejaj-slopu.- AI i technologie przyszłości

Elity się zorientowały, wiedzą co trzeba robić, żebyś nic nie miał i był zadowolony, a przynajmniej nie pyskował.- W jakie gry gracie i jakie polecacie?? 2022 edition

No to wszystko jasne. Bo to dla tych SMART... ja nie jestem, to nie dostałem. Więc nie będę się pieklił, tylko sobie pójdę zaraz do OPSu, może coś dadzą w ramach ścieżki RETARDED.- Speedpaint 2025

- AI i technologie przyszłości

Można powiedzieć, że ejaj to taki great leveler, jak śmierć... huehue. Nie ważne czy użyje tego Bagiński, Arnowski, jakiś Zagórski czy dowolny kowalski... wszystkim wyjdzie takie samo gówno.- AI i technologie przyszłości

Zgaduje/stawiam, że Bagins robi to dla przekory/dla jaj... ale i tak rozczarowanie.- AI i technologie przyszłości

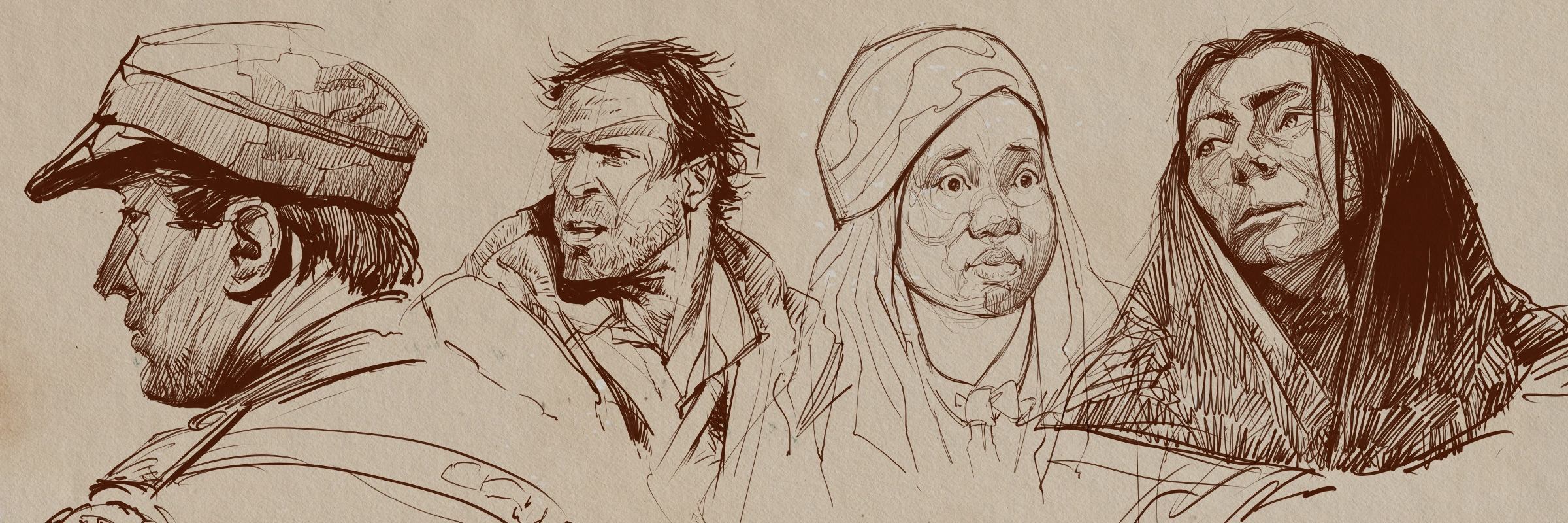

Eee tam. Jego estetyka ma jedną wspólną rzecz, którą faktycznie potrafi zachować; mierne opanowanie narzędzi twórczych połączone z pretensjonalnością przekazu. Ale czy to powód do zadowolenia. Jak dla mnie ten ejajslop to dowód na to, że tam nigdy nie było głębszej myśli w tej jego twórczości. To zawsze był tylko grafoman i ejaj tylko to jeszcze wyraźniej pokazało. Czepiał się każdego tfurcy, że tylko truizmami sypie, a sam niestety niemowa. A jak się chopek oszukuje, że to wszystko jego, widać duma rozpiera... 🤣 Tak, tak, "jego" i głębokie niczym kałuże z tego szitu. Ale to jest chyba taki pattern, że jak ktoś robił ejajslop zanim pojawiło się ejaj, to teraz poszedł w to jak świnia w koryto... kolejny przykład michael kutsche (mój ulubieny renderengine) i jego delirki o facecie co zrobił film o HALu-9000 🤣:- Teczka kitu i shI†u

- AI i technologie przyszłości

A ja myślałem czy sobie nowego dysku na dane nie kupić... haha Dobrze, że do NAS zdążyłem wsadzić dwa nowe jakieś poł roku temu huehue. "Western Digital has no HDD capacity left, as its CEO reveals massive AI-driven deals have consumed available supply" https://wccftech.com/western-digital-has-no-more-hdd-capacity-left-out/ Tymczasem w HP można już (podobno) zasubskrajbować laptopa: https://x.com/PimpMasterYoda1/status/2021172869275734178 A Sony rozwiązuje problemy z konsolowymi SSD storage (no bo im też ciężko kupić, bo ejaj) i będzie streamować content: https://x.com/Pirat_Nation/status/2022357796486808008 Coraz fajniej to ejaj zmienia świat na lepsze. 🤣- Drobniejsze newsy, ciekawostki, misc

Kolejny raz, można spróbować nauczyć się Houdiniego i polec. Tym razem za pośrednictwem nowego edu huba od sidefx. https://www.sidefx.com/learn/learning-library/tutorials/ news: https://x.com/sidefx/status/2021738328002101536- W jakie gry gracie i jakie polecacie?? 2022 edition

Diablo 2, nowa postać. Dla mnie pozytywne zaskoczenie, chociaż raczej i tak nie skorzystam. Spotlight na 30 lecie diabełka: https://www.youtube.com/watch?v=KnAsWN-6hvw- AI i technologie przyszłości

@polka dot chyba za bardzo poszedłeś w eteryzm. Moralnie możesz się spierać jak tam sobie chcesz, czy natura to czy tamto, tantiemy itp... czysto praktycznie ludzkość uznała, że warto pewne rzeczy chronić prawnie, pomimo a nawet wbrew naturze... reszta to już piana.- AI i technologie przyszłości

No to trochę taki strzał kompletnie z okrężnicy, jakbyśmy historii nie znali. Po to właśnie mamy konwencję berneńską, podpisaną przez wszystkie praktycznie kraje świata, bo się okazało, że taka jest potrzeba społeczna. I to społeczeństwa międzynarodowego. Bo technologia i logistyka robiła kuku w zakresie, który trzeba było okiełznać prawnie w czasach Wiktora Hugo. Teraz powinniśmy zrobić tego rodzaju podobny twór, uwzględniając zmiany technologiczno/logistyczne które nadeszły w związku z ejajem. W skrócie tylko napiszę, bo uważam, że ktoś ogarnięty sam jest w stanie wysnuć resztę wniosków... ale ogólnie chodzi o to, że prawo autorskie ma sens w tej formie jakiej istnieje (pomijam pewne problemy, które wynikają z niedoskonałości, bo to przymiot wszelkiej rzeczy), ponieważ zostało stworzone dla ludzi uwzględniając ich ograniczenia! I dlatego mamy coś takiego jak dozwolony użytek prywatny, bo wiemy, że nikt nie ma 1mln. znajomych, żeby uwalić cały rynek np. muzyczny. Albo nie ma nikt problemu z kopią czy nawet parafrazą dzieł, bo to ma swoje ograniczenia wynikające z przymiotów ludzkich. Natomiast problem z ejajem, jeżeli chodzi o prawo autorskie jest taki, że tam żadnych ograniczeń nie ma. Ejaj może "zapamiętać" miliard dzieł sztuki i wypluć niemal identyko konkurencyjny produkt w ilościach nieograniczonych. Dlatego to co działało powiązane jako prawo z "biologią ludzką", nie działa już w zestawieniu z "biologią wirtualną ejaja". I tak jak potrzebowaliśmy konwencji międzynarodowej w 19 wieku, tak teraz potrzebujemy czegoś nowego, regulującego sensownie wolną amerykankę ajsloppingu.- AI i technologie przyszłości

Nikt się nie spodziewał: https://www.404media.co/vibe-coding-is-killing-open-source-software-researchers-argue/- Bentley Continental GT 2026

Bez wnętrza i silnika?! Phi.- Max3D 2020 - Komentarze i uwagi

To chyba tylko ci, którzy wrzucają obrazki gdzieś indziej, a na maxie tylko linkują obrazek. To działa. Problem jest z uploadem na serwer maxowy najwyraźniej.- Szybkie odpowiedzi na proste pytania. Blender Q&A

to akurat nie do końca taki szybki temat, chociaż nie jest to przesadnie skomplikowane i przewałkowane na jutube milion razy, więc chyba nie ma sensu tutaj tłuc piany, chyba że będziesz miała jakiś konkretny problem i utkniesz. Na razie zerknij na któryś z brzegu powinno być ok. https://www.youtube.com/results?search_query=baking+procedural+textures+blender- Sebastian Szmyd

dobra dobra, sam se znalazłem fotkę.- Sebastian Szmyd

Cuda panie, a poka stanowisko swoje. Chcę zobaczyć twój syf :). Pyndzle, woda, kubki, plamy... chcę sobie potem powiedzieć, też bym tak pomalował, ale nie mam gdzie tego syfu zrobić ;P- Max3D 2020 - Komentarze i uwagi

U mnie dalej tak samo. Nie mogę wgrać, nawet przez d&d. Teraz sprawdziłem na mobile i to samo. Android duckduck browser. A mialem pospamowac obrazkami haha.- Max3D 2020 - Komentarze i uwagi

Ja klikałem też. Bez różnicy.- Drobniejsze newsy, ciekawostki, misc

Niewiele wiadomo na razie... osobiście stawiam na coś bliższego anime... ale kto wie. Tu jeszcze trochę info: https://theghostintheshell.jp/en/news/the-ghost-in-the-shell-music-key-visual Oficjalna stronka serialu: https://www.theghostintheshell-anime.jp/ - AI i technologie przyszłości

Powiadomienie o plikach cookie

Wykorzystujemy cookies. Przeczytaj więcej Polityka prywatności Umieściliśmy na Twoim urządzeniu pliki cookie, aby pomóc Ci usprawnić przeglądanie strony. Możesz dostosować ustawienia plików cookie, w przeciwnym wypadku zakładamy, że wyrażasz na to zgodę.